Nieuw beeldmodel ChatGPT Images 2.0: praktijktest voor ondernemers

Een AI-beeldmodel dat eerst nadenkt voordat het een afbeelding maakt. Dat klinkt als marketingtaal, maar het is wat OpenAI op 21 april 2026 heeft uitgerold in ChatGPT. Het nieuwe model, ChatGPT Images 2.0, denkt eerst na over de compositie, controleert zijn eigen output en kan zelfs het internet raadplegen voordat er één pixel verschijnt.

In de praktijk levert dat leesbare tekst in beelden op, meertalige teksten die daadwerkelijk kloppen, hogere resolutie en personages die herkenbaar dezelfde blijven over meerdere afbeeldingen heen. Het nieuwe model zit sinds kort in ChatGPT, inclusief de gratis versie. Betaalde abonnementen (Plus, Pro en Business) krijgen toegang tot de volledige thinking mode met redeneerfunctie. Ontwikkelaars kunnen het ook via de API aanroepen als gpt-image-2.

Een productaankondiging is één ding. Voor ondernemers telt vooral of het gereedschap echt werkt. Daarom heb ik het model een aantal praktische tests laten uitvoeren. De resultaten deel ik in deze blog met je.

Wat is technisch nieuw in ChatGPT Images 2.0?

De belangrijkste vernieuwingen zijn het redeneervermogen in de zogenoemde thinking mode, waarin het model de scène eerst uitdenkt voordat het gemaakt wordt. De resolutie gaat tot 2K en beeldverhoudingen lopen van 3:1 tot 1:3. Naast Latijns schrift kan het model nu ook Japans, Koreaans, Hindi, Bengaals en Arabisch redelijk nauwkeurig weergeven. Tot slot kan het systeem tot acht samenhangende beelden uit één prompt produceren, waarbij personages, objecten en kleuren herkenbaar gelijk blijven over de reeks.

De standaardversie is beschikbaar voor alle ChatGPT- en Codex-gebruikers. De thinking mode is voorbehouden aan betaalde abonnementen (Plus, Pro en Business). Dat heeft een reden. De thinking mode is trager. Waar eerdere modellen binnen enkele seconden iets produceerden, kan een complexe generatie nu één tot twee minuten duren.

Test 1: fotorealisme en lokale context

Ik vroeg om een foto van een kat op een skateboard in de Amsterdamse straten, met bokeh-effect. Het resultaat is overtuigend. De grachtenpanden, het plaveisel en het licht kloppen met wat je in Amsterdam verwacht. Ook de diepteweergave van het bokeh klopt met een reële fotografische lens. Dit is op zichzelf geen nieuwe functie, maar de scherpte en realisme zijn beter dan bij de vorige generatie.

Test 2: consistentie bij bewerking van een eigen foto

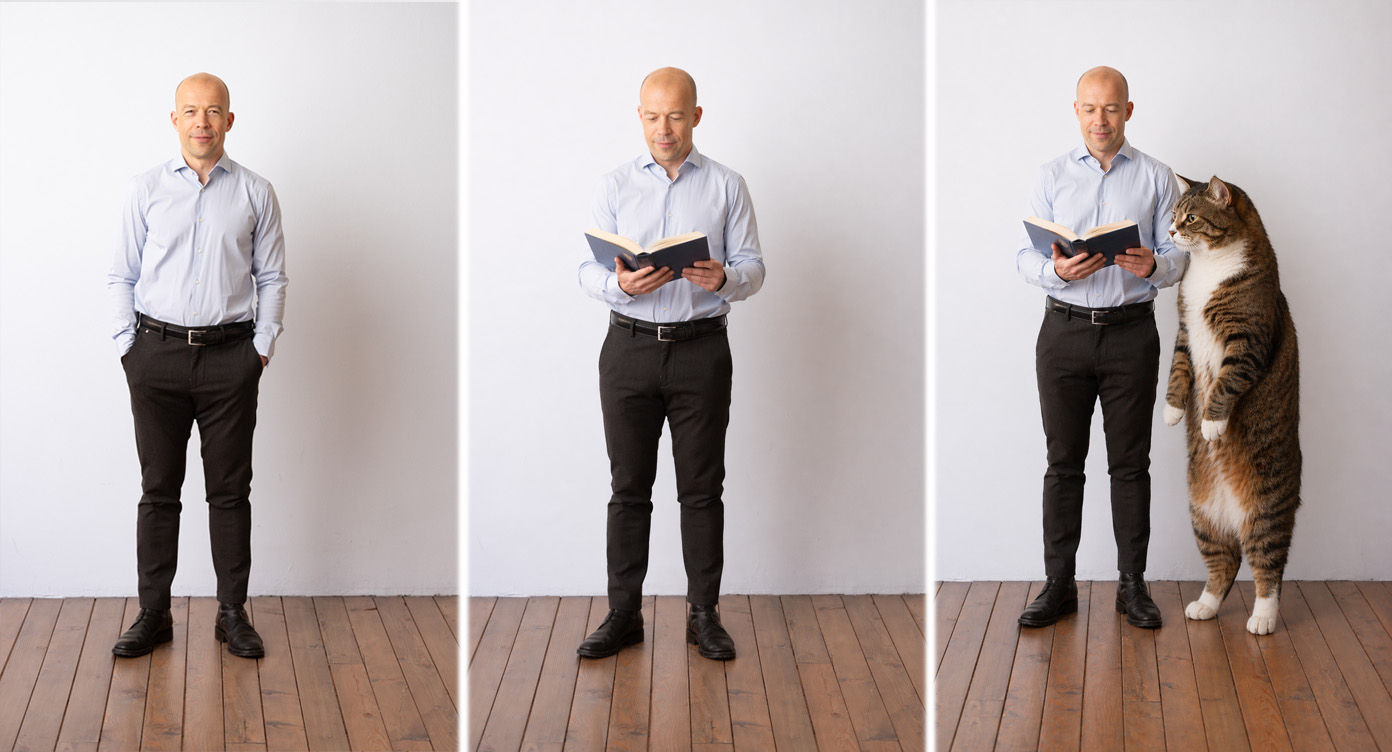

Vervolgens heb ik een bestaande foto van mijzelf geüpload en gevraagd om de laptop te vervangen door een boek. Daarna heb ik in twee vervolgstappen gevraagd om een kat toe te voegen die meeleest en om die kat vervolgens even groot te maken als de man. In alle drie de beelden blijf ik herkenbaar als dezelfde persoon. Kleding, houding, kapsel, gezicht en belichting blijven over de reeks heen consistent. De scène verandert, het personage (ik) niet.

Waar eerdere modellen bij een tweede of derde bewerking het gezicht subtiel vervormden of de belichting anders maakten, houdt dit model de persoon over meerdere stappen herkenbaar. Ook objectveranderingen (een kat toevoegen, schaal drastisch wijzigen) lopen niet meer automatisch tegen rare afwijkingen aan.

Dit is belangrijker dan het op het eerste gezicht lijkt. Voor bedrijven die bestaande foto’s van medewerkers, producten of locaties willen hergebruiken in nieuwe visuals, is dit het eerste model van OpenAI dat dat op een bruikbaar niveau doet. Een reeks van meerdere visuals rond dezelfde persoon of hetzelfde product is nu haalbaar in één sessie.

Test 3: begrijpt het model ook context?

Interessanter dan pure beeldkwaliteit is de vraag of het model begrijpt wat het maakt. Daarvoor heb ik twee opdrachten ingevoerd die alleen kloppen als het model de fysieke gevolgen van de situatie begrijpt:

- Een kartonnen doos die al twee weken in de stromende regen in een tuin heeft gelegen.

- Een lasagne die twee dagen op 250 graden in de oven heeft gestaan. Dit voorbeeld pikte ik op bij een test van een ander beeldmodel en bleek een goede manier om contextbegrip te vergelijken.

De resultaten zijn veelzeggend, maar niet perfect. De doos is verweerd, ingezakt en doorweekt. Het model voegt verkleuring toe. De lasagne is aangebrand en zwartgeblakerd, met een verschrompeld oppervlak.

Bij de lasagne zit een interessante beperking. Twee dagen op 250 graden zou in werkelijkheid niet leiden tot een aangebrande ovenschotel, maar tot een volledig verkoolde, asachtige klomp waar geen lasagne-structuur meer in te herkennen is. Het model begrijpt de richting (te lang en te heet betekent verbrand), maar onderschat de omvang. Het lijkt te mikken op een realistisch, herkenbaar eindresultaat in plaats van op de fysiek juiste uitkomst.

Het systeem blijkt in deze tests niet alleen het onderwerp te begrijpen (doos, lasagne), maar ook het gevolg van tijd, vocht en hitte, ook al schat het de extremen nog niet helemaal goed. OpenAI zelf spreekt hier overigens niet over fysische simulatie, maar over betere instructievolging en compositie.

Voor prompts waar de fysieke extremen er echt toe doen, moet je die extremen dus expliciet benoemen (“volledig verkoold”, “tot as vergaan”).

Test 4: de echte stresstest

Ook heb ik het model een vierluik laten maken met dezelfde vrouw op vier locaties (Tokio, Marrakesh, Kolkata en Lissabon), met elk een eigen schriftsysteem en leesbare teksten in vertrekborden, menuborden, een krant en een poster, plus een tijdlijn onderaan.

Het model gaf een goed resultaat. Het hoofdpersonage blijft consistent over alle vier panelen. De Japanse katakana op het vertrekbord is leesbaar, het Arabische menu klopt inhoudelijk met de Franse vertaling eronder en bevat plausibele dirhamprijzen. De Bengaalse krantenkop is leesbaar en de infographic telt op tot honderd procent. De Portugese poster heeft een correct geschreven datum. De tijdzones onderaan kloppen voor alle vier de steden. Dat is lastiger dan het lijkt, want het model moet zowel de juiste tijden weten als ze foutloos in beeld schrijven.

Niet alles gaat vlekkeloos. Bij zeer kleine typografie treden af en toe nog letterfouten op, en de QR-code in het Lissabon-paneel is decoratief en niet functioneel. Wie QR-codes of barcodes nodig heeft in een visual, kan die beter apart genereren en inplakken.

Prompt:Een vierluik (2×2 grid, 16:9, 2K) getiteld “Een dag in vier steden”, met door alle panelen heen hetzelfde hoofdpersonage: een vrouw van ongeveer 30 jaar met kort rood haar, een mosterdgele regenjas en een leren schoudertas — haar gezicht, kapsel en jas moeten in alle vier de panelen exact hetzelfde zijn. Paneel 1 — Tokio, 07:12: zij staat in station Shinjuku, regen op glas, neonreclames met leesbare Japanse kanji en katakana (“新宿駅 東口”, “ラーメン 880円”, “出口”). Een digitaal vertrekbord toont drie treinen met tijden en perrons. Filmische Wong Kar-wai-achtige belichting. Paneel 2 — Marrakech, 13:40: zij op een terras, zachte middagzon. Een handgeschilderd menubord in Arabisch schrift met vijf gerechten + prijzen in dirham, daaronder Franse vertaling. Messing theepot met correcte reflectie van de scène. Paneel 3 — Kolkata, 17:55: zij op een markt, straatbord in Bengaals schrift (“কলেজ স্ট্রিট”), een krantenstalletje met een krant waarvan de kop leesbaar is en een korte infographic (staafdiagram van 4 balken met labels en percentages die optellen tot 100%). Paneel 4 — Lissabon, 22:30: zij aan de kade, maanlicht op de Taag. Een poster aan een muur in correct Portugees met titel, datum (14 de Junho de 2026), locatie, en een QR-code in de hoek. Reflectie van haar gele jas in een plas op de kasseien. Onderaan het hele vierluik één doorlopende witte balk met een tijdlijn: vier stippen met stadsnaam + lokale tijd + UTC-offset, verbonden door een dunne lijn. Typografie: serif voor titels, sans-serif voor data. Consistent kleurpalet (mosterdgeel, diep blauwgroen, warm wit) over alle panelen.

Tips voor fotorealistische resultaten

Fotorealisme komt niet vanzelf. Ook niet bij dit model. Je kan de AI instructies geven om betere resultaten te krijgen.

Benoem de camera en de lens.

“Sony A7 IV met 85mm f/1.4” geeft een heel ander resultaat dan simpelweg “foto”. Het model imiteert de karakteristieken van de genoemde apparatuur, zoals compressie, bokeh en scherpteval. Dit werkt ook met bewust beschreven limitaties: “iPhone snapshot, licht overbelicht” geeft een ander geloofwaardig realisme dan een studio-opname.

Specificeer het licht.

“Zachte namiddagzon door een raam links”, “bewolkt, diffuus licht” of “studiolicht met softbox links en reflector rechts” zijn bruikbare aanwijzingen. “Natuurlijk licht” is te vaag en levert meestal een gemiddelde, vlakke belichting op. Een tijdsaanduiding zoals “gouden uur” of “blauw uur” is vaak sterker dan abstracte kleurtermen.

Vraag om imperfecties.

“Lichte filmkorrel”, “subtiele motion blur op de achtergrond”, “wat slijtage op het leer” voorkomt de gladde, steriele look waaraan AI-beelden vaak te herkennen zijn. Dit geldt dubbel voor huid en stof. Een beetje textuur is geloofwaardiger dan perfect glad.

Wil je een specifieke look? Noem dan een concrete filmsoort: “Kodak Portra 400”, “medium format film” of “35mm met warme toning” geven elk een herkenbare kleurcurve. Dit werkt beter dan vage termen als “filmisch”.

Controleer altijd op fouten. Schaduwen moeten kloppen bij de lichtrichting die je beschrijft. Handen, oren en horloges blijven bekende zwakke punten. Een extra menselijke controleronde is vrijwel altijd nodig.

Welk beeldformaat kies je?

Images 2.0 ondersteunt beeldverhoudingen van 3:1 (extreem breed) tot 1:3 (extreem hoog). In ChatGPT kun je in de interface kiezen tussen horizontaal, vierkant en verticaal, of je noemt de verhouding expliciet in je prompt (bijvoorbeeld “16:9” of “vertical portrait”).

Per toepassing een vuistregel:

- Voor Instagram-feedposts, LinkedIn productvisuals en algemene social kies je vierkant (1:1).

- Voor YouTube-thumbnails, presentatieslides, websitebanners en e-mailheaders gebruik je horizontaal, meestal 16:9 of 3:2.

- Voor Instagram Stories, Reels, TikTok en mobiele landingspagina’s ga je verticaal: 9:16 of 2:3.

- Voor sitebanners, X-headers en brede e-mail banners pak je ultrabreed (3:1).

- Voor reguliere fotografie en print blijft 3:2 de standaard.

Resolutie

ChatGPT Images 2.0 levert in de gewone chat-interface beelden tot 2K (ongeveer 2048 pixels op de langste zijde). Voor social media, websites, presentaties en kleiner printwerk is dat meestal voldoende. Voor grootformaat printwerk, zoals posters groter dan A4, beursbanners of hoogwaardige magazine-opmaak, schiet het tekort. De vuistregel: bij 300 dpi print is 2K tot ongeveer 17 cm breed nog scherp. Wil je groter printen, dan is upscaling achteraf noodzakelijk via tools. Je kunt ook de API gebruiken waar een 4K-beta beschikbaar is.

Serie

Als je een serie maakt voor meerdere kanalen (bijvoorbeeld vierkant, 9:16 en 16:9 tegelijk), vraag het model dan expliciet om dezelfde scène in verschillende verhoudingen. Dat levert iets anders op dan hetzelfde beeld achteraf uitsnijden. Het model kadert namelijk zelf opnieuw en houdt daarbij de belangrijkste elementen in beeld, in plaats van dat je hoofden of productinformatie buiten beeld verliest. Voor campagnes waarin dezelfde visual op meerdere plekken terug moet komen, scheelt dit aanzienlijk werk.

Mensen gelijk houden in verschillende beelden

Een belangrijke toevoeging voor wie beelden maakt met mensen. Puur tekstueel beschrijven van een persoon (leeftijd, haardracht, baard, kleding) geeft bij dit model nog lichte variatie in gezichten tussen kaders. Genereer in dat geval eerst één beeld dat je goedkeurt en gebruik dat vervolgens als referentiefoto voor de andere formaten. In mijn tests gaf die werkwijze merkbaar strakkere gezichtsconsistentie over meerdere kaders heen dan tekstueel werken. Voor drieluiken, carrousels of campagnes waarin beelden direct naast elkaar staan, is dit het verschil tussen “dezelfde persoon” en “drie mannen die op elkaar lijken”.

Hieronder het resultaat uit mijn test: eerst de goedgekeurde referentiefoto in 16:9, daarna de twee vervolgkaders (1:1 en 9:16) die met die foto als anker zijn gegenereerd.

De goedgekeurde referentiefoto (16:9), gebruikt als visueel anker voor de vervolgkaders.

Vervolgkader voor Instagram-feed (1:1), gegenereerd op basis van de referentiefoto. Gezicht, baard en omgeving blijven herkenbaar dezelfde.

Vervolgkader voor Instagram Reels (9:16), ook op basis van de referentiefoto.

Wat betekent ChatGPT Images 2.0 voor ondernemers?

Voor marketingbeelden, advertenties, social posts en productvisualisaties is dit nieuwe model in ChatGPT een interssante optie. Het levert direct bruikbaar materiaal, zonder dat een ontwerper achteraf tekstlagen hoeft te plaatsen of fouten moet wegwerken.

Voor meertalige communicatie is het ook een serieuze tool. Wie export doet naar Arabische of Aziatische markten kan nu visuals met correcte tekst laten genereren in de doeltaal, in plaats van die tekst achteraf handmatig met Photoshop te plaatsen.

Voor beeldseries met consistente personages (denk aan een huisstijlmascotte of een reeks visuals voor een campagne) is de drempel verlaagd. Wat voorheen een traject van dagen was met extra tooling, is nu een sessie van een uur.

Let wel op kosten en doorlooptijd. De thinking mode is niet gratis en niet snel. Voor hoge volumes of voor eenvoudige visuals kan een goedkoper en sneller model nog steeds de betere keuze zijn. En zoals bij elk gesloten cloudmodel geldt: wie gevoelige bedrijfsinformatie in prompts zet, doet er verstandig aan de privacy- en gebruiksvoorwaarden goed te lezen voor beeldmateriaal met klantdata of interne documenten het systeem ingaat.

ChatGPT Images 2.0 is geen revolutie in esthetiek, maar wel in betrouwbaarheid. De verbeteringen zitten in consistentie, tekstweergave en contextbegrip. Het verschil met de vorige generatie wordt vooral duidelijk bij opdrachten die eerder onmogelijk waren: acht samenhangende panelen, leesbare tekst in vier schriftsystemen, of een lasagne die daadwerkelijk verkoold is na twee dagen in een veel te hete oven.

Voor ondernemers die beeld inzetten in marketing, productcommunicatie of interne documentatie, is dit het moment om deze nieuwe versie serieus uit te proberen. Begin met een concrete toepassing uit je eigen werk (een campagnereeks, een meertalige productvisual, een serie social posts) en beoordeel het resultaat en de besparing ten opzichte van je huidige workflow.

Beeldgeneratie is één puzzelstuk. Wil je ontdekken waar AI in jouw bedrijf nog meer tijd, werk of kosten kan besparen? Neem dan vrijblijvend contact op met AIMonnik.nl.